Вы встретили в интернете видео, где известный блогер или знаменитость говорит или делает что-то неожиданное для себя или даже неприличное? Не спешите делать выводы. Возможно, перед вами дипфейк. Современные технологии достигли высокого уровня и стали создавать настолько реалистичные поддельные фото и видео, что их трудно отличить от настоящих.

Такой контент называется дипфейками, и, хотя они могут показаться безобидной шуткой, на самом деле они несут серьезные угрозы, особенно для подростков. Эта статья поможет понять, что такое дипфейки, как их распознать и что делать, чтобы обезопасить себя в интернете.

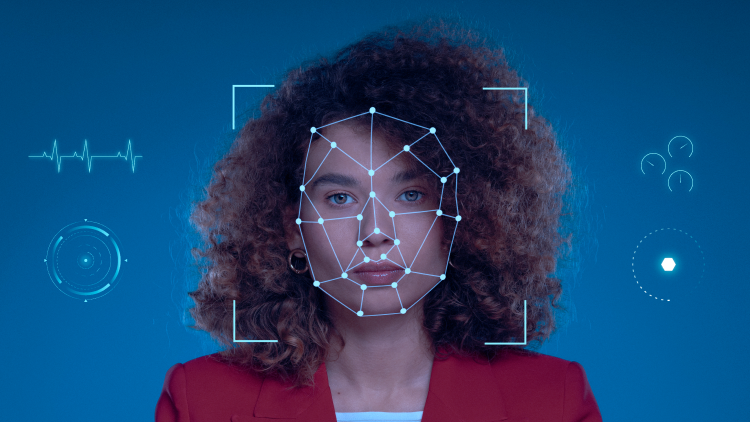

Дипфейки (от англ. deepfake) — это видео или изображения, созданные с помощью искусственного интеллекта. Лица и голоса на них могут быть подменены так, что это выглядит как реальность. Например, на видео актер произносит фразу, которой он никогда не говорил, или делает что-то абсолютно нехарактерное. Это и есть работа дипфейков в интернете: они подделывают реальность, вводя людей в заблуждение.

Но не только популярные люди становятся «моделями» для поддельных видео – любой может стать героем провокационных роликов или фотографий против своей воли, и ребенок должен знать об этих рисках.

Дипфейки не просто развлечение. Они могут нанести серьезный вред, особенно в руках злоумышленников.

В 2019 году пользователи наблюдали спикера Палаты представителей США Нэнси Пелоси, которая с трудом говорила из-за, как показалось всем, состояния алкогольного опьянения. На самом же деле речь демократки имитировал искусственный интеллект, и недоброжелатели распространили это видео на широкую публику.

В другом ролике Борис Джонсон (на тот момент глава Консервативной партии Великобритании) агитировал британцев голосовать за соперника Джереми Корбина.

Порнография с поддельными героями – еще одна угроза, которую несет технология. По данным экспертов в сфере ИИ, 96% поддельных фото и видео в интернете — порнография, в большинстве случаев с использованием женских лиц и образов, взятых из интернета.

Часто в дипфейках движения губ не совсем совпадают с речью или выглядят слегка неестественно. Обратите внимание на то, как лицо двигается во время речи — если что-то кажется неправильным, это может быть фейк.

Глаза двигаются неестественно, моргание кажется слишком редким или отсутствует вовсе. Это связано с тем, что генерация реалистичного движения глаз — сложная задача для искусственного интеллекта. Внимательно следите за движениями тела. Часто дипфейки плохо справляются с плавными движениями или мелкими деталями, такими как движения пальцев, шеи или плеч.

Несмотря на мощность технологий, некоторые дипфейки все еще могут быть размытыми, иметь низкое качество изображения или искажения. Также можно заметить нечеткость границ вокруг головы и волос.

Если в видео используется поддельный голос, можно заметить неправильные интонации, задержки или слишком механическое звучание. Это особенно заметно, если голос плохо синхронизирован с движениями губ.

В дипфейках часто заметны проблемы с освещением. Тени могут выглядеть ненатурально, световые эффекты не совпадать с общим освещением сцены.

.svg)

.svg)

.svg)

И, конечно, напомните подростку, что лучшая защита — это критическое мышление. Даже если видео кажется настоящим, не стоит сразу верить всему, что видишь. Поощряйте ребенка задавать вопросы и не принимать на веру любую информацию.

.svg)